The Window into the future_Chapter 3. Artificial Intelligence

현재의 시그널을 빠르게 읽어, 미래를 예측하는 퓨처플레이의 ‘Future Analytics Report’를 쉽게 풀어드립니다. 보다 쉽고 빠르게 미래를 만날 수 있는 FP Exclusive Series ‘Signals’가 매주 찾아옵니다.

Signals_Ep.1 : 인공지능의 시대를 산다.

“인공지능은 인간의 대부분을 대체할 것이다.”

웹3와 메타버스보다 한참 이전부터 21세기를 점령한 키워드 중 하나인 인공지능은 1956년 미국 다트머스의 학회에서 존 매카시 교수가 처음 제안한 뒤 현재까지 사용되고 있다. 유관 연구는 다양한 이유로 여러 차례 정체되었으나 몇 번의 도약을 반복하며 현재의 인공지능에 도달했다. 인공지능과 인간이 공존하는 사회가 어떤 모습일지에 대해서는 여전히 갑론을박이 존재하지만 본 에피소드에서는 위의 명제를 바탕으로 인공지능에 대체 되어가는 여러 산업을 조명하고 그 미래를 그려볼 것이다.

해당 시리즈는 인공지능에 대한 포괄적 소개를 담고 있는 본 에피소드를 시작으로 인공지능 기술의 산업 적용 사례와 대체 예정인 산업군에 대한 인사이트를 담고 있는 후속편으로 구성되었다. 이 일련의 포스팅이 독자들에게 완숙한 인공지능 기술이 존재하는 사회가 어떤 형태를 띌지 상상하는 계기가 되었으면 한다.

대개 인공지능을 몹시 복잡하고 어려운 개념으로 받아들이지만, 필자는 위의 문제를 활용하여 최대한 간단하게 설명해보고자 한다. 해당 문제는 y=ax+b라는 일차함수가 두 점 A(1, 4), B(3, 3)을 지나도록 하는 기울기(a)와 절편(b)을 구하는 문제로 국내 초등 교육 과정에서 소개된다. 이때 문제에서 제공되는 두 점 A(1, 4)와 B(3, 3)는 인공지능에서 흔히 말하는 데이터 세트의 기능을 수행하며, c는 인공지능을 통해 예측해야 하는 목표 값을, y=ax+b는 과거 데이터를 통해 학습되어야 하는 인공지능의 기능을 한다. 즉, 과거에 존재했던 값을 활용해 미지의 수식을 완성하고 새로운 값을 예측해야 한다는 점에서 위 문제와 인공지능은 정확히 일치하는 기능을 가진다. 그렇다면 초등학생도 풀 수 있는 일차함수와 동일한 기능을 가지는 인공지능이 필요한 이유는 무엇일까? 여러 이유가 존재하겠지만 필자가 생각할 때 가장 핵심적인 두 이유는 1. 과거 데이터를 활용해 도출되어야 하는 수식이 너무 복잡해서, 2. 데이터가 숫자의 형태로 존재하지 않아서 인 것 같다.

당연하게도 우리가 풀어야 하는 대부분의 문제는 일차함수로 해결되지 않는다. 변수의 개수가 몇십 혹은 몇 백 개에 이르기도 하며, 선형 함수로는 아예 표현되지 않아 비선형 함수가 필요한 경우도 존재한다. 인공지능은 학습을 통해 자동으로 수많은 변수를 적재적소에 활용하여 학습 데이터를 가장 잘 가공하는 수식을 도출한다. 그러나, 데이터가 숫자로 존재하지 않는다면 그 어떤 수식도 무용지물이 된다.

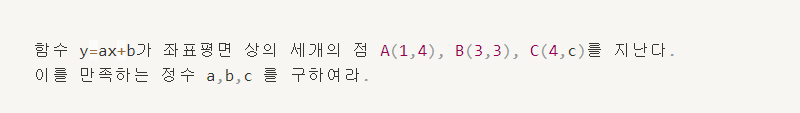

이처럼 숫자로 표현되지 않는 데이터는 보통 비정형 데이터(Unstructured Data)라고 일컬어지며 흔히 인터넷에 존재하는 데이터 중 80% 정도가 이 형태로 존재할 것으로 예상한다. 사람의 음성, 이미지, 텍스트 등이 비정형 데이터에 해당하는데 다양한 인공지능 모델 중 인코더(Encoder)는 이러한 데이터를 숫자로 변환하는 역할을 한다. 필자는 숫자의 형태로 존재하지 않아 기존에 다루지 못했던 영역의 데이터까지 다룰 수 있도록 하는 것이 인공지능이 필요한 이유 중 하나라고 생각한다.

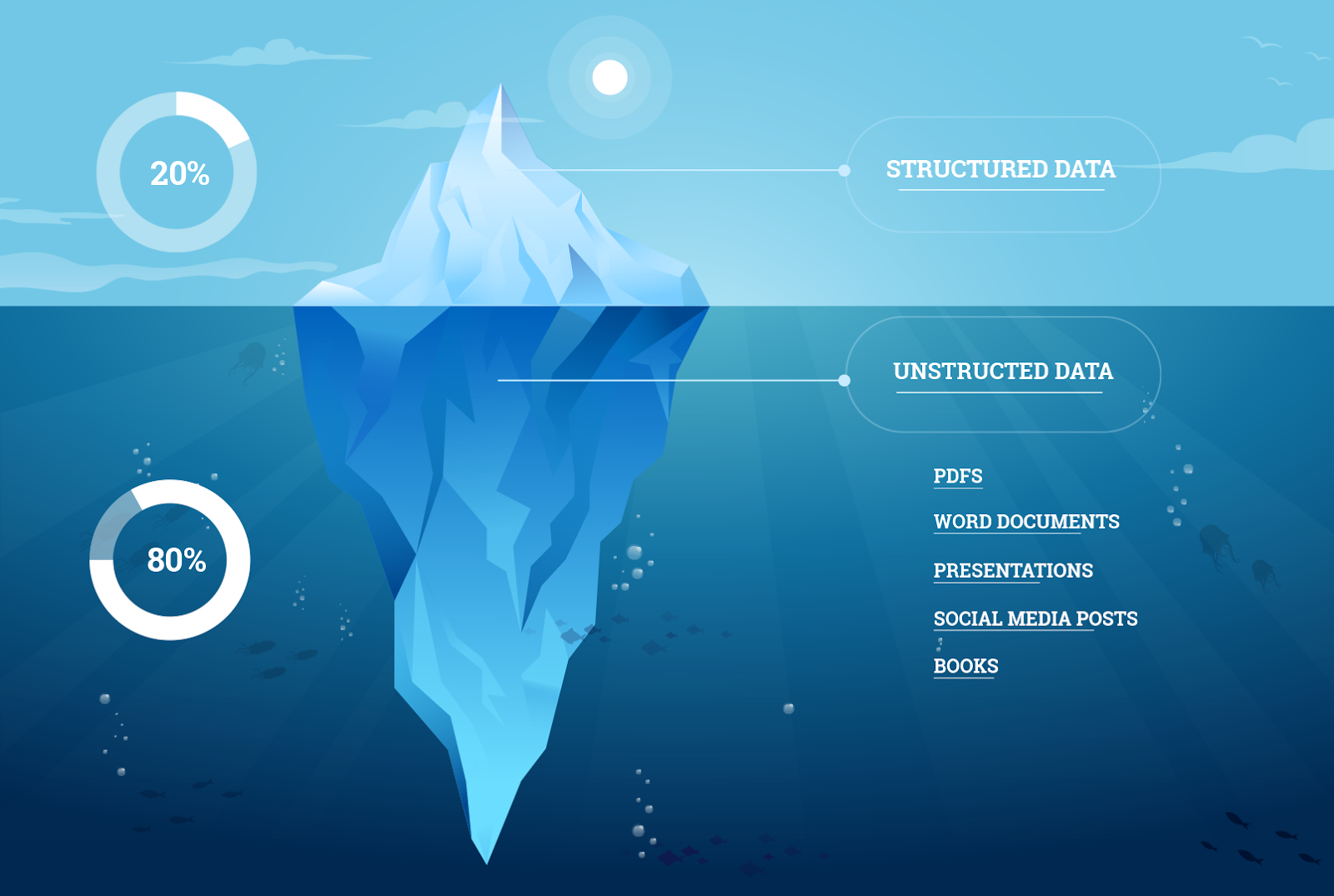

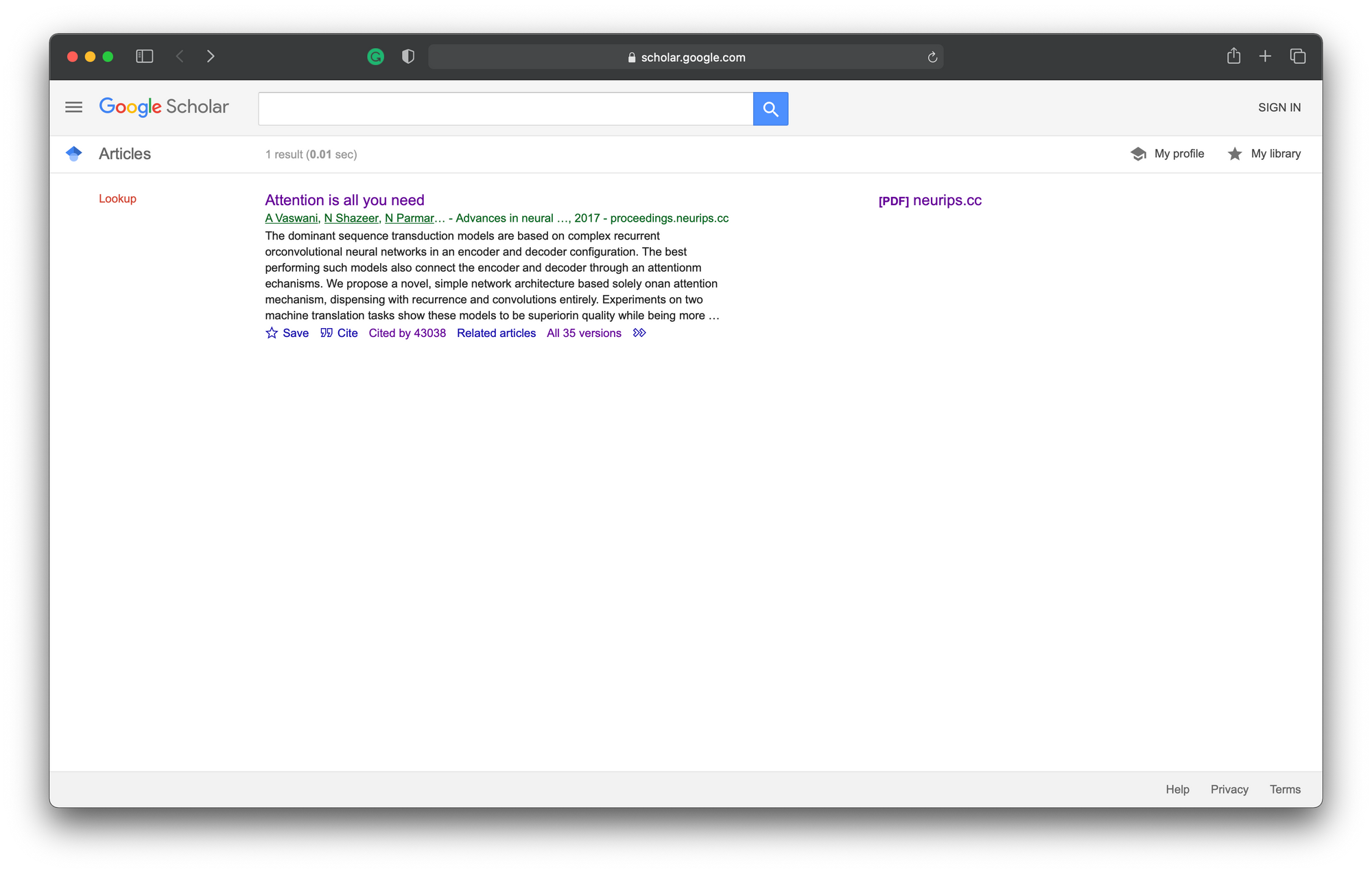

비정형 데이터를 숫자로 성공적으로 변환하고, 이를 연산하는 수식까지 만들어 낼 수 있다면 인공지능은 한계가 없는 것 일까? 인공지능 연구가 본격적으로 점화된 2010년 이후에도 모델 아키텍처나 하드웨어의 한계로 인해 대부분의 인공지능 기술은 프로덕트에 바로 사용되기에는 부족한 성능을 보여주었다. 그러나 2017년 “Attention is all you need”라는 논문을 통해 Transformer라고 불리는 아키텍처가 제안 되었고 해당 모델은 모델의 사이즈를 키우는 족족 성능이 향상되는 비현실적인 scalability를 보여주었다. Transformer 아키텍처는 발표 이후 자연어, 이미지, 음성 등 분야와 관계없이 SOTA(State-of-the-Art)를 달성하는 모습을 보여주고 5년 간 총 43,000회 인용되며 초거대 인공지능의 시대를 열었다.

초거대 인공지능이란 모델이 가지는 파라미터의 수를 극적으로 늘려 성능 향상을 꾀한 인공지능을 지칭하며, Transformer 아키텍처의 발표 이후로 새로운 모델이 등장하지 않고 있는 현재로서는 더 큰 모델과 데이터 세트를 사용하는 것이 성능을 향상하는 거의 유일하고 가장 손쉬운 방법으로 꼽히고 있다. 단적인 예로 2021년 Beijing Academy of AI가 공개한 Wu Dao 2.0은 불과 3년 전에 OpenAI 가 공개한 GPT 모델의 15,000배 이상으로 성장하였으나 근본적으로는 동일한 Transformer 아키텍처를 사용하고 있다.

최근에 연이어 등장하고 있는 초거대 인공지능은 여러 과제에서 사람과 거의 유사한 수준의 near-human performance를 보여주며 영화 아이언맨의 Jarvis와 같은 인공 일반 지능(Artificial General Intelligence; AGI)이 곧 개발될 듯한 기대감을 모으고 있다. 다음 포스팅에서는 AGI에 대해 알아보고 이를 통해 현대 인공지능의 지평을 확인한다.

🚨 본 콘텐츠의 저작권은 (주)퓨처플레이에 있으며 저작권법에 의해 보호 받고 있으므로 무단 복제, 편집, 배포 및 사용을 금지합니다. 저작권 침해시 민형사상의 책임을 물을 수 있습니다.

⚡이전 Signals가 궁금하다면?

👉ENOUGH IS ENOUGH

✏ Writer

손규진 GUIJIN SON

Data Analyst, Strategic Planning Team

• 한국정보처리학회 준회원

• 연세대학교 언더우드 국제대학, 경제학 학사 (재학)

/futureplay.co/common/logo.png)